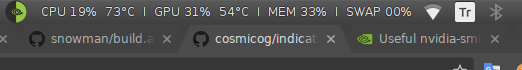

There are several Gnome Shell extensions to display system resource usage in Ubuntu, but in this tutorial I’m going to introduce an indicator that works in not only GNOME, but also Unity, MATE, and Budgie desktop environments.

It’s Indicator-SysMonitor, a free and open-source applet developed by the leader of Ubuntu Budgie team.

With it, user can display the usage and/or temperature of the following system resource in top-panel:

- average CPU usage.

- NVIDIA GPU utilization.

- Memory usage.

- network upload/download speed.

- CPU, NVIDIA GPU temperature.

- Swap usage.

- Public IP address.

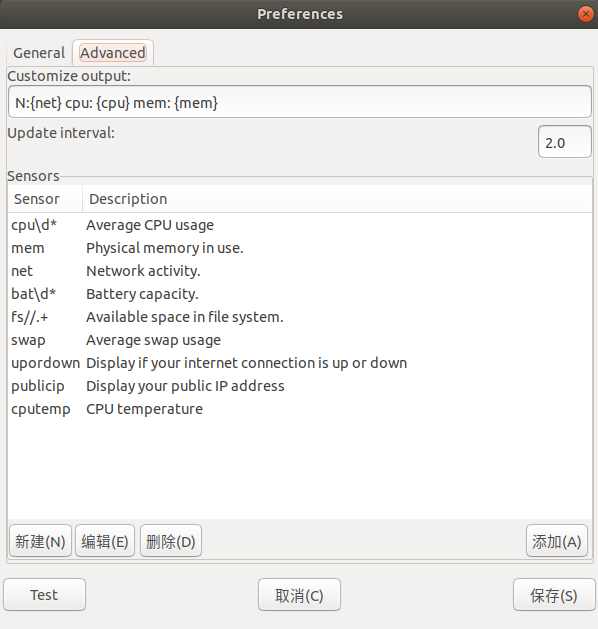

Most important is that user can customize the output, by setting which one or ones to display, in which order with which text. User just need to click the indicator on panel to open ‘Preferences’ dialog from pop-down menu, and format the output code in ‘Advanced’ tab.

How to Install Indicator-Sysmonitor

The developer has an Ubuntu PPA contains the packages for Ubuntu 18.04, Ubuntu 20.04, Ubuntu 22.04, Ubuntu 22.10, and even the next Ubuntu 23.04.

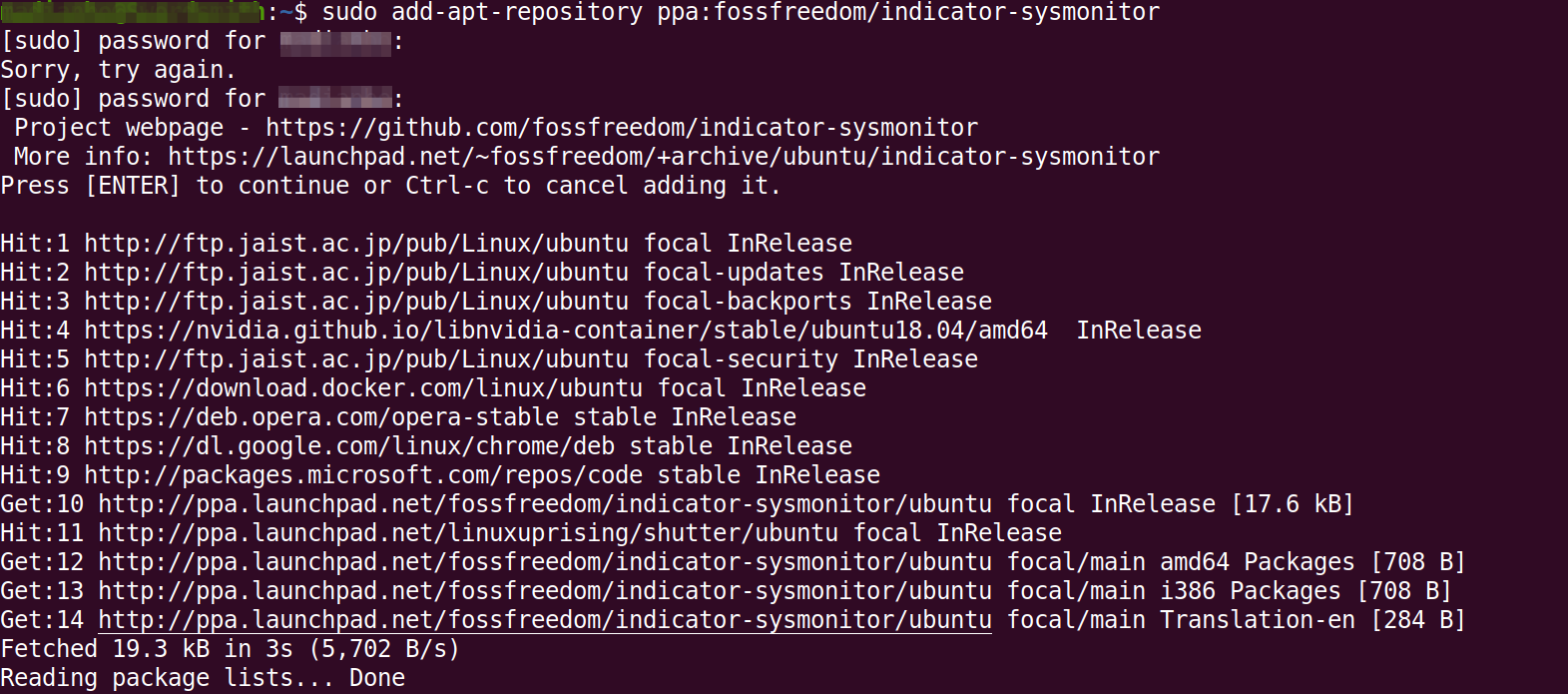

1. First, press Ctrl+Alt+T on keyboard to open a terminal window. When it opens, run command to add the PPA:

|

1 |

sudo add-apt-repository ppa:fossfreedom/indicator-sysmonitor |

Type user password when it asks and hit Enter to continue.

2. For the old Ubuntu 18.04, you need to manually refresh package index after adding PPA:

|

1 |

sudo apt update |

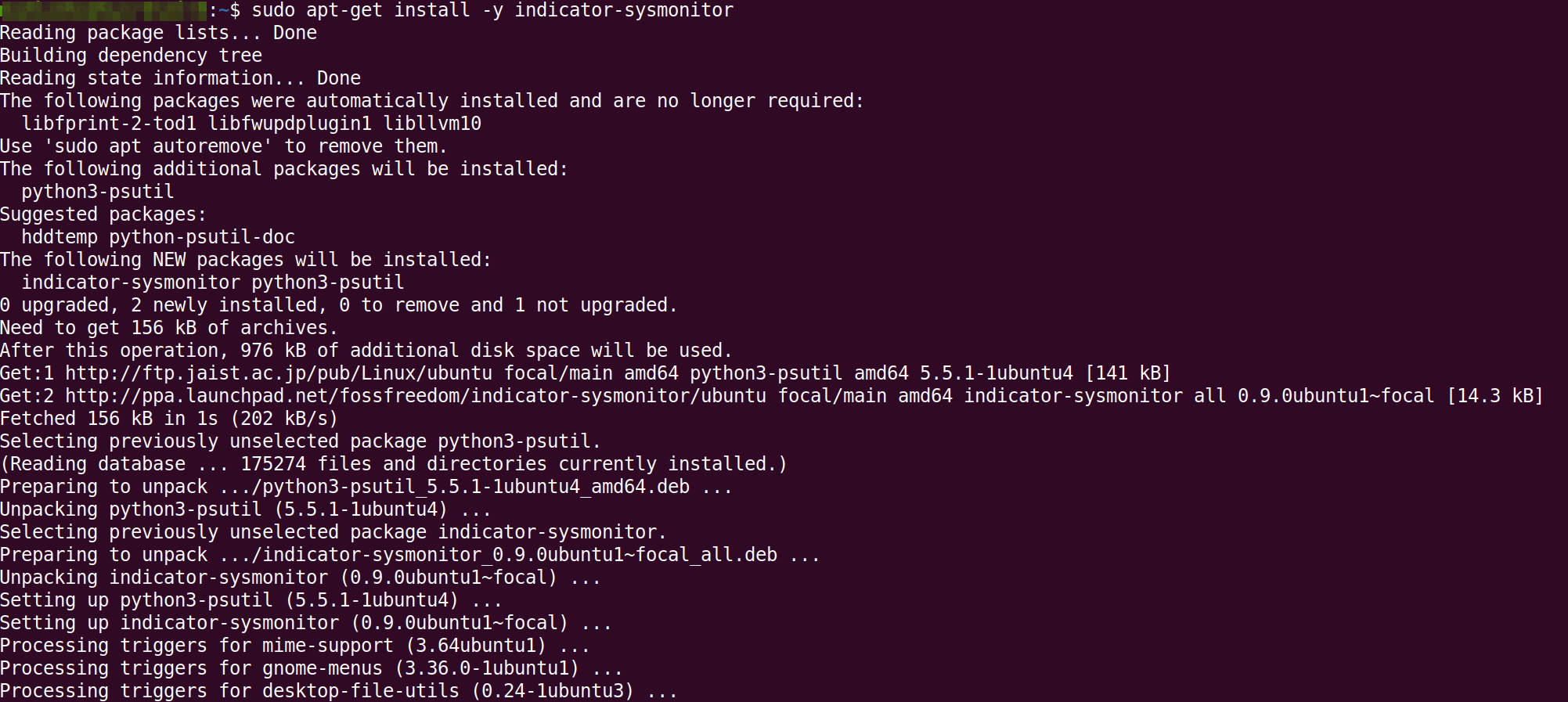

3. And, install the indicator applet via command:

|

1 |

sudo apt install indicator-sysmonitor |

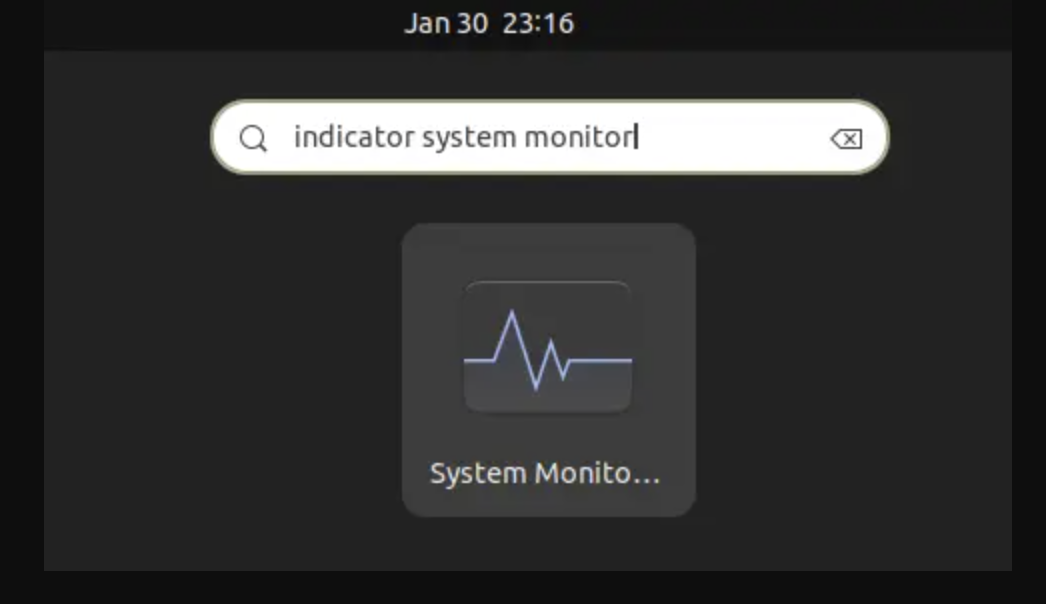

Finally, search for and open the applet like a normal application (it has same icon to System Monitor).

And click on the applet to open Preferences, and turn on start at login, configure output layout, refresh interval, etc.

Uninstall Indicator-Sysmonitor

You can close the applet by clicking on it in panel and select “Quit”. And remove the package at any time by running a single command in terminal window:

|

1 |

sudo apt remove indicator-sysmonitor |

Also remove the PPA repository, either by running the command below or open “Software & Updates”and remove source line under “Other Software” tab.

|

1 |

sudo add-apt-repository --remove ppa:fossfreedom/indicator-sysmonitor |

参考链接

This Indicator Shows CPU, GPU, Memory Usage on Ubuntu 22.04 Panel